Une consommation électrique en forte croissance

Bien que la plupart de nos données soient stockées à l’étranger (USA notamment), la France comptait déjà 300 centres de données en 2022, consommant environ 10 TWh par an1 (soit environ 2 % de la production électricité française). En 2025, ce chiffre est passé à 333 centres pour une consommation totale de 15 TWh/an. De nombreux nouveaux projets sont ainsi lancés en France, favorisés par l’ambition nationale en IA et la disponibilité d’une électricité décarbonée.

Selon le récent rapport du Shift Project, l’IA est le principal moteur du développement des data centers. La consommation mondiale pourrait bondir de 460 TWh en 2022 à 2 250 TWh/an en 2035, voire 3 000 TWh/an si les cryptomonnaies se développent fortement.

Pour la France, RTE prévoyait une consommation de 23 à 28 TWh/an en 2035 (soit environ 4 % de la consommation électrique française à cet horizon). Toutefois, l’étude du Shift Project estime que, sur la base des annonces faites lors du sommet de l’IA, ce chiffre pourrait atteindre 45 TWh/an, soit 7,5 % de l’électricité consommée en France à la même date.

Maxime Efoui-Hess, coordonnateur des programmes “Numérique” et “Industrie & Matières” au Shift Project, a contribué à la préparation de cette conférence mais n’a malheureusement pas pu y participer. Son étude est consultable en ligne – Intelligence artificielle, données, calculs : le rapport final du Shift (https://bit.ly/3Lo9rdr)

Une production de chaleur de plus en plus intense à évacuer

Jean-Christophe Leonard, ingénieur de l’Institut Supérieur Fluides, Énergie, Réseaux et Environnement de Mines Paris, Chercheur expert au sein de la direction R&D d’EDF, a situé l’importance de la production de chaleur par effet Joule au niveau des puces et des racks de serveurs qui constituent les data centers.

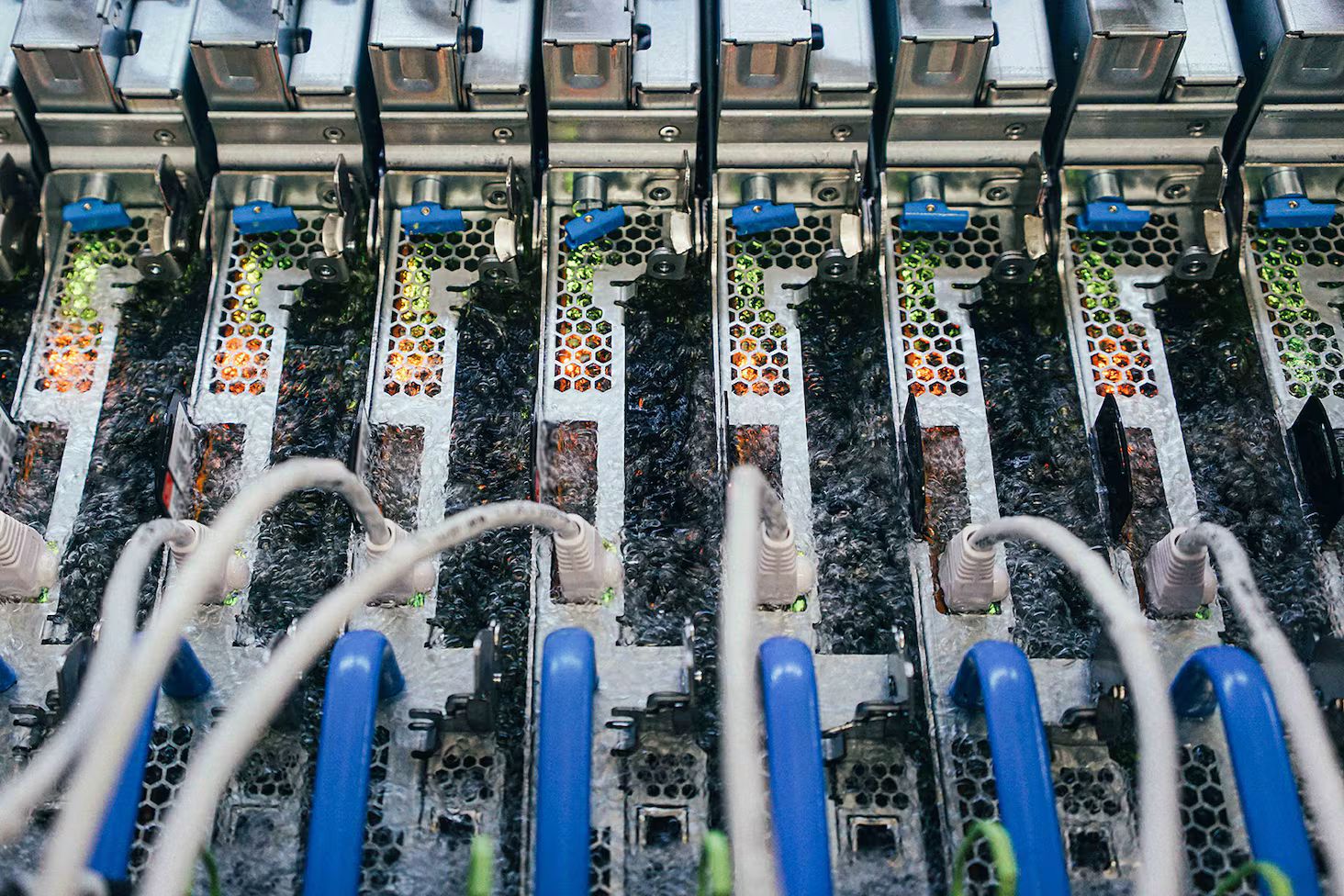

Les dimensions moyennes d’un rack sont de 0,6m x 1,2m au sol, avec une hauteur voisine de 2 mètres. Sa consommation moyenne est passée de 10-12 kW en 2020 à plus de 15 kW aujourd’hui, et continue d’augmenter avec l’évolution technologique. Au-delà de 50 kW/rack, le refroidissement par air ne suffit plus à protéger les composants de la chaleur. Il faut alors passer au “liquid cooling” (refroidissement par liquide), soit par un circuit interne aux racks, soit par immersion des serveurs dans un liquide diélectrique, généralement une huile minérale. Le choix de l’huile reste délicat. Les premières huiles utilisées dissolvaient les plastifiants du PVC présents dans les câbles et autres composants, un problème aujourd’hui résolu. Subsiste toutefois la difficulté de manipuler les serveurs lors des interventions : il faut les sortir du bain et notamment en retirer les couches minces ou les traces d’huile, ce qui augmente les coûts de maintenance. Pour des consommations dépassant 100 kW/rack, que l’on peut anticiper à l’avenir, une nouvelle technologie est en développement : l’immersion avec changement de phase, où un liquide caloporteur entre en ébullition au sein même du serveur.

L’efficacité énergétique des data centers est mesurée par le PUE (power unit effectiveness), un indicateur normalisé qui rapporte l’énergie totale consommée à celle utilisée uniquement par les équipements informatiques. Ce ratio dépend principalement de la qualité du transfert de chaleur avec le fluide de refroidissement et de la performance des machines réfrigérantes. En France, le PUE moyen s’établit à 1,6.

Les opérateurs mettent en avant l’amélioration de ce ratio pour démontrer leurs efforts. Toutefois, cette progression ne doit pas masquer l’augmentation considérable de la consommation électrique globale.

Dans les centres classiques, la chaleur est simplement dissipée dans l’atmosphère, sans récupération possible. Les installations récentes permettent en revanche de récupérer cette chaleur via un circuit d’eau qui ressort à une température voisine de 30°C.

Une grande difficulté de récupération de la chaleur fatale

Différents cas pratiques ont été présentés. Un exemple classique de récupération de chaleur est celui d’une piscine située à proximité d’un data center, dont 95 % des besoins énergétiques (environ 3 GWh/an) sont ainsi couverts. L’eau sortant du centre à 55°C peut être utilisée directement par le centre nautique.

La meilleure situation, du point de vue thermique, suppose un écart inférieur à 70°C entre la source froide (sortie du data center) et la source chaude (besoin de l’utilisateur). Au-delà, il faut recourir à des pompes à chaleur (PAC) biétagées, nécessairement plus complexes et plus fragiles. Or les situations optimales sont rares : certains réseaux de chaleur fonctionnent avec de l’eau très chaude, tandis que les systèmes de refroidissement des data centers ne sont pas toujours conçus pour maximiser la température de sortie.

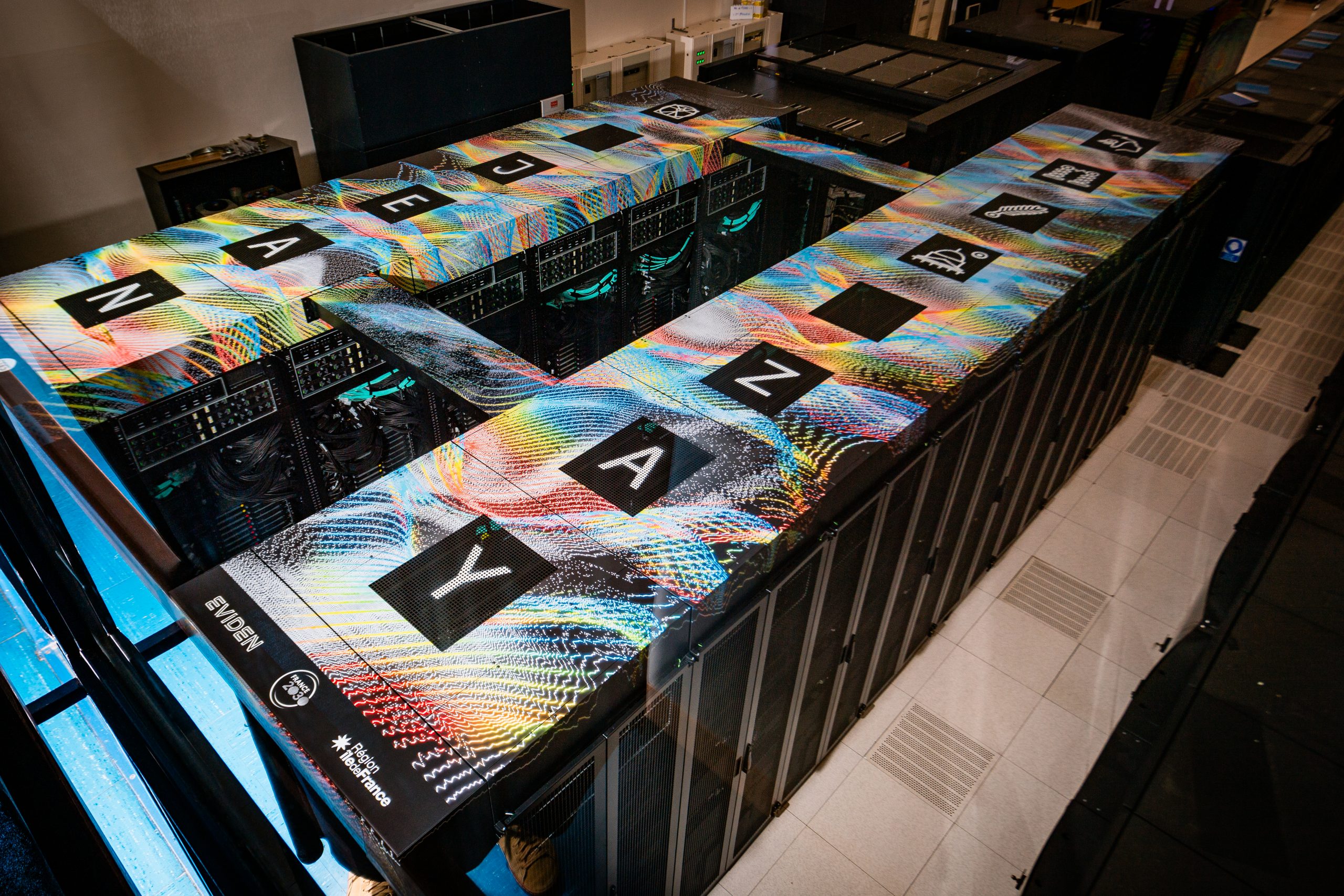

Un cas exemplaire2 est celui du supercalculateur Jean Zay de l’IDRIS (Institut du Développement et des Ressources Informatiques Scientifiques), qui fournira 4 à 8 GWh/an au réseau de chaleur et de froid de Paris-Saclay. Ce démonstrateur européen de réseau de 5ᵉ génération fonctionne avec une eau circulant entre 20 et 30°C, chaque sous-station disposant d’une PAC réversible chaud/froid.

La récupération de chaleur n’est pas une priorité pour les opérateurs de data centers. Leurs critères de choix privilégient largement la proximité au réseau électrique (RTE pour les plus gros sites), l’accès au réseau de câbles de données numériques, le foncier disponible ainsi que le coût de l’électricité. Cette récupération ne constitue d’ailleurs pas une source de revenus significative : les opérateurs sont prêts à livrer la chaleur gratuitement en limite de propriété.

Selon une directive européenne et la loi REEN (Réduire l’Empreinte Environnementale du Numérique), qui accorde un tarif réduit d’électricité aux centres de données, toute nouvelle installation de plus de 1 MW doit faire l’objet d’une étude de récupération de chaleur. Toutefois, aucune obligation de mise en œuvre n’est imposée.

Les plus grosses installations observées en France récupèrent jusqu’à 10 GWh de chaleur par an. Une réalisation exceptionnelle existe au Danemark avec 80 GWh/an récupérés (data center de Meta à Odense).

Un concept intéressant émerge ; les “chaudières numériques”. Cela consiste à disperser des serveurs de quelques kW dans les immeubles pour assurer leur chauffage ou produire l’eau chaude sanitaire.

Le défi du développement des réseaux de chaleur

Nicolas Daniel, directeur de la stratégie, du marketing et de la communication du Groupe Idex, a présenté la vision d’un opérateur engagé dans la décarbonation du chauffage des bâtiments via le développement des réseaux de chaleur. En France, 1 000 réseaux de chaleur distribuent actuellement environ 30 TWh/an, soit seulement 5 à 6 % de la chaleur consommée (600 TWh/an de consommation brute). Parmi cette chaleur distribuée, à peine 2,3 % proviennent de la chaleur fatale des data centers.

Pour atteindre les objectifs de la Stratégie Nationale Bas Carbone (SNBC), il faudrait construire 1 600 réseaux supplémentaires. L’ADEME priorise trois sources : d’abord la chaleur fatale, puis la géothermie, et enfin la biomasse.

Si les objectifs sont identifiés, leur mise en œuvre se heurte à de nombreuses contraintes technico-économiques : compatibilité entre la température de sortie du data center et les besoins des utilisateurs, le caractère rédhibitoire d’un seuil de distance maximale à environ un kilomètre entre la source et les consommateurs de chaleur.

Une équation pour conclure

AI = E : Comme l’a déclaré Sam Altman, dirigeant d’OpenAI, lors d’une audition au Congrès américain : “À terme, le coût de l’IA convergera vers le coût de l’énergie.”

Les questions soulevées durant la session

Quelle consommation d’eau ? Elle peut devenir très importante si on utilise le refroidissement adiabatique. Il existe une relation empirique entre la consommation d’eau et la consommation électrique du centre de données. Aux USA elle est de 1 litre / kWh, ce qui peut devenir insupportable. En France, ce ratio est voisin de 0,2 litre/kWh.

Quelle sécurité électrique ? Les data centers utilisent batteries et groupes électrogènes de secours capables de reprendre toute l’alimentation. Ils sont classés ICPE (Installation Classée pour l’Environnement). Les sites critiques disposent de serveurs redondants, y compris sur un second site si possible assez proche, distant de 20 km au plus.

La récupération de chaleur : un élément d’attractivité ? Non, ce n’est pas un facteur décisif. L’accès à l’électricité et la disponibilité foncière priment. La France dispose d’un surplus d’électricité décarbonée, mais pâtit d’obstacles réglementaires. Deux tendances émergent : gros centres près des centrales nucléaires ou petits centres moins énergivores en raccordement sur le réseau électrique.

Quid du stockage géothermique de la chaleur ? Les températures de sortie des data centers sont trop faibles pour un stockage efficace dans le sol.

Pour approfondir ces sujets complexes, la conférence est disponible en replay.